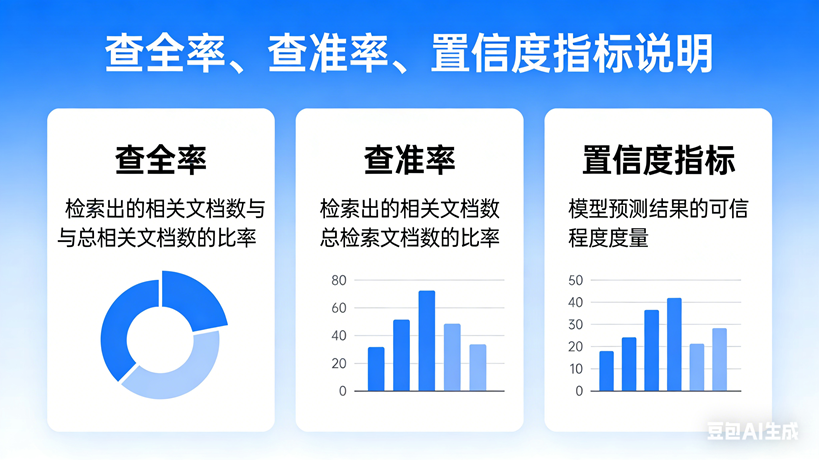

AI分析:查全率,查准率,置信度

以下内容为AI生成,请谨慎甄别

| 中文名称 | 英文名称 | 核心问题 | 理想状态 |

|---|---|---|---|

| 查准率 | Precision | 预测为正例的结果中,有多少是真正正确的? | 宁缺毋滥 |

| 查全率 | Recall | 所有真正的正例中,有多少被找出来了? | 一网打尽 |

| 置信度 | Confidence | 模型对这个结果有多大的把握? | 高置信度往往代表高可靠性 |

1. 查准率

- 英文: Precision

- 别名: 精确率

- 定义:

它衡量的是预测为正类的样本中,有多少是真正的正类。简单来说,就是看模型“猜对了”多少它认为是正确的东西。 - 通俗理解:

如果你去百度搜“苹果”,搜出来的结果(预测为正)一共有10条,其中8条真的是关于苹果的(真正例),那么查准率就是 80%。 - 关注点: “我不关心我漏掉了多少,我只关心我捞上来的这些有多少是对的。”

- 公式: Precision=TPTP+FPPrecision=TP+FPTP

2. 查全率

- 英文: Recall

- 别名: 召回率

- 定义:

它衡量的是实际为正类的样本中,有多少被成功预测出来了。简单来说,就是看模型“漏掉了”多少正确的东西。 - 通俗理解:

全世界一共有100部关于苹果的电影(实际为正),百度只收录(召回)了其中的60部,那么查全率就是 60%。 - 关注点: “我不关心我是不是搜错了,我只关心真正的目标我搜出来了多少。”

- 公式: Recall=TPTP+FNRecall=TP+FNTP

简单记忆法:查准 = 查得 准不准(质量)查全 = 查得 全不全(数量)

3. 置信度

- 英文: Confidence 或 Confidence Score

- 定义:

在机器学习中,置信度通常指模型对其预测结果的概率估计或确定程度。它表示模型认为“这个预测有多大的可能性是正确的”。

在分类任务中:

- 比如一张图片通过Softmax函数输出:

[猫:0.85, 狗:0.10, 猪:0.05]。 - 这里的 0.85 就是模型对“这是一只猫”这个预测的置信度。

在目标检测任务中(最常见):

- 当模型画出一个框框住某个物体时,通常会附带一个置信度分数。

- 含义: 这个分数代表“这个框里真的有物体的概率”以及“这个物体属于某一类别的概率”的乘积(或综合)。

- 作用: 通常我们会设定一个阈值(如0.5),只保留置信度大于0.5的检测结果。提高阈值可以提升查准率(因为留下的框质量高),但会降低查全率(因为很多模糊的物体被过滤掉了)。